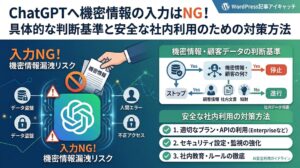

ChatGPTで情報漏洩が起こる原因とは?プラン別のセキュリティ比較と対策ガイドライン7項目

ChatGPTをはじめとする生成AIの急速な普及に伴い、企業の情報システム担当者やセキュリティ責任者は「便利だが、情報漏洩が怖い」というジレンマに直面しています。

特に、情報漏洩への懸念から、社内利用を制限している企業も少なくありません。 しかし、リスクの正体を正しく理解し、適切な対策を講じれば安全な活用は可能です。

この記事では、ChatGPTで情報漏洩が起こる仕組みと対策方法・会社のガイドラインとして設定すべき項目について解説していきます。

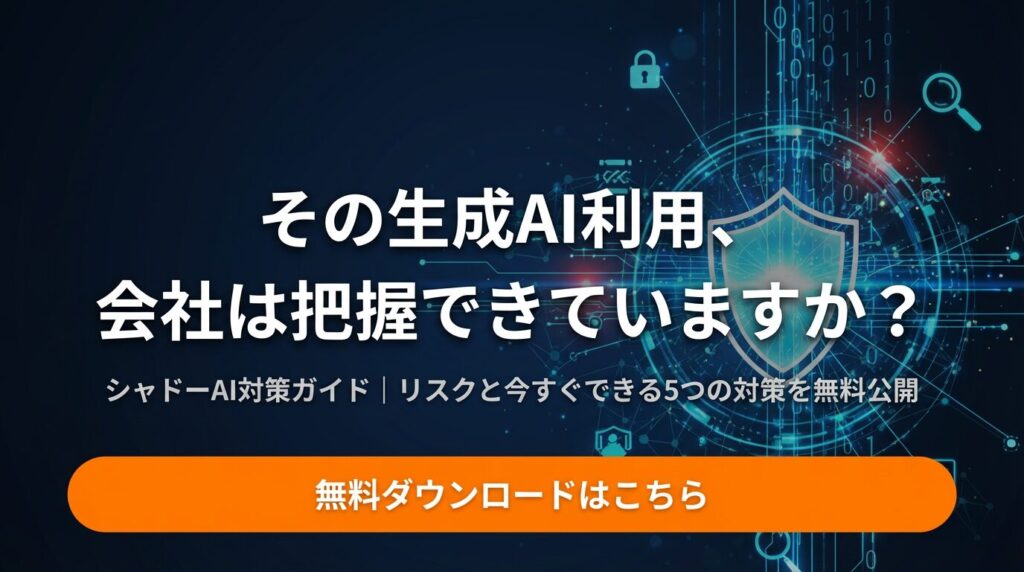

シャドーAI対策ガイド|社員のAI利用に潜むリスクと今すぐできる対策

「社員がAIツールを使っているかもしれないが、実態が把握できていない」

——そんな不安を抱えていませんか?

IBMの調査によると、シャドーAI起因のデータ漏洩は通常より67万ドル(約1億円)コストが増大するという結果が出ています。

本資料では、シャドーAIの3大リスクと今すぐ始められる5つの対策ステップに加え、そのまま使えるAI利用ポリシー策定チェックリスト・入力禁止情報リストを収録しています。

以下から無料でダウンロードいただけます。

社内稟議に使える|ChatGPT法人プラン導入提案キット

社員が個人アカウントでChatGPTを使っている状況、放置していませんか?

法人プラン(Business/Enterprise)のプラン比較、ROI試算、セキュリティ要件、稟議書テンプレートまで、社内提案に必要な情報を1冊にまとめました。

こちらのバナーから無料でダウンロードいただけます。

ChatGPTで情報漏洩はなぜ起こる?リスクの正体と仕組み

ChatGPTでの情報漏洩の原因として、まず理解すべきは「どのような経路で情報が外へ出るのか」というメカニズムです。

リスクは大きく分けて技術的な仕様によるものと、ユーザーの利用形態によるものの2つに分類されます。

入力データの「学習利用」による二次漏洩のリスク

Web版の個人向けプラン(Free/Plus)をデフォルト設定のまま使用すると、プロンプトに入力した内容はOpenAI側のモデル学習に利用される可能性があります。

これは、入力した機密データがAIの知識の一部となり、他者が類似の質問をした際に意図せず出力されてしまう「二次漏洩」のリスクを意味します。

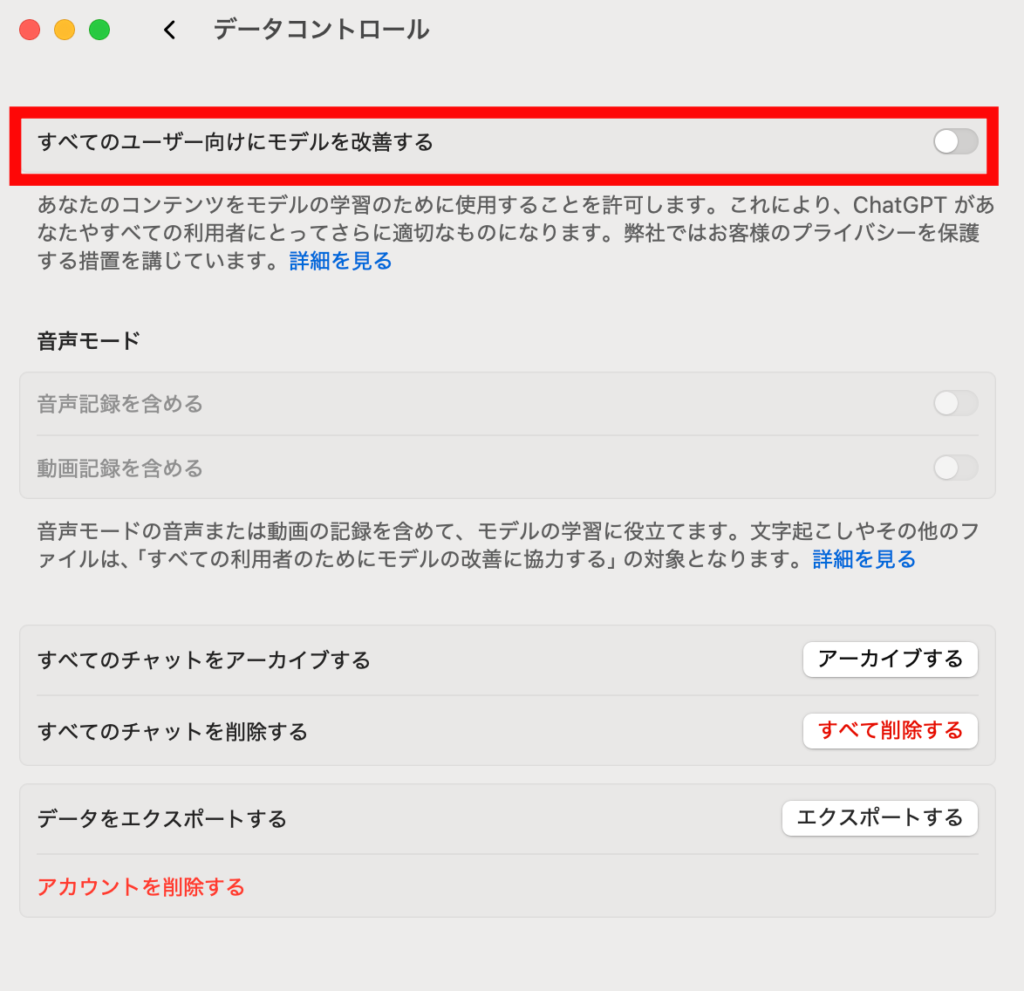

個人向けプランでは「すべてのユーザー向けにモデルを改善する」をオフにしない限り、入力データは再学習の対象となります。

【個人向けプランで学習利用を避ける方法】

1. 設定を開く

2. 「データコントロール」を選択

3. 「すべてのユーザー向けにモデルを改善する」をオフ

過去のインシデント事例:履歴タイトル流出と決済情報のバグ

ChatGPTをはじめとした生成AIツールは100%安全ではなく、システム的な脆弱性による漏洩リスクも存在します。

過去には、韓国のサムスン電子で同社エンジニアが社内ソースコードをChatGPTにアップロードし、誤ってリークさせた事案が発生しています。

同社はこの事案発生後、知的財産と分かる可能性のある会社関連の情報や個人データを入力しないよう全社員に求め、従わない場合は解雇もあり得ると警告しています。

(出典:Bloomberg)

法人として利用する以上、技術的な限界があることを前提に、プロンプトに機密情報を直接含めない運用が不可欠です。

シャドーAI(非公認利用)が最大の漏洩ルートになる理由

最大の脅威は会社が公認していないAI利用、いわゆる「シャドーAI」です。

シャドーAIはIPA(独立行政法人 情報処理推進機構)が発表した2026年版の「情報セキュリティ10大脅威」で3位にランクインしているほど、企業のセキュリティリスクとして捉えられています。

実際、従業員が個人のアカウントを業務で利用すケースだと、IT部門によるガバナンスが及びません。

アカウントの乗っ取りが発生しても検知できず、インシデント発生時のログ調査も不可能になるため、組織統制の外での利用を防ぐことが最優先事項となります。

会社が把握していない「勝手なAI利用」をいかに防ぐかがセキュリティの鍵となります。

シャドーAI対策ガイド|社員のAI利用に潜むリスクと今すぐできる対策

「社員がAIツールを使っているかもしれないが、実態が把握できていない」

——そんな不安を抱えていませんか?

IBMの調査によると、シャドーAI起因のデータ漏洩は通常より67万ドル(約1億円)コストが増大するという結果が出ています。

本資料では、シャドーAIの3大リスクと今すぐ始められる5つの対策ステップに加え、そのまま使えるAI利用ポリシー策定チェックリスト・入力禁止情報リストを収録しています。

以下から無料でダウンロードいただけます。

【プラン別】セキュリティ比較と法人利用の選択基準

情報漏洩リスクを最小化するための最も強力な対策は、適切な利用プランの選択です。

個人向け(Free/Plus)と法人向け(Team/Enterprise)の決定的違い

法人向けプランである「ChatGPT Team」および「Enterprise」では、OpenAIは「入力データをモデルの学習に使用しない」ことを明確に保証しています。

また、データの暗号化やSSO(シングルサインオン)による認証統合など、エンタープライズレベルのセキュリティ機能が標準提供されています。

個人向けプランの設定に頼る運用は、従業員の操作ミスを誘発するため法人利用としては不適切です。

TeamプランとEnterpriseプランの「監査ログ」の壁

法人プラン間でも、管理機能に差があります。特に「監査ログ」の取得範囲が重要です。

Enterpriseプランでは、管理者が組織内の会話データを外部ツールへ出力し、監視・アーカイブすることが可能です。 高度な監査体制が必須の企業や大企業では、Enterpriseプランの導入が推奨されます。

厳格なコンプライアンスが求められる組織では、監査ログの外部出力が可能な上位プランが適しています。

最も安全な選択肢としての「API利用」と社内専用UIの構築

さらに高い安全性を求める場合、ChatGPT APIを利用して自社専用のチャットUIを構築する選択肢があります。

API経由のデータは標準で学習に利用されず、会話履歴をOpenAI側のサーバーに保持させない設計も可能です。 独自のフィルタリング機能を実装することで、技術的に漏洩をブロックする体制を構築できます。

社内稟議に使える|ChatGPT法人プラン導入提案キット

社員が個人アカウントでChatGPTを使っている状況、放置していませんか?

法人プラン(Business/Enterprise)のプラン比較、ROI試算、セキュリティ要件、稟議書テンプレートまで、社内提案に必要な情報を1冊にまとめました。

こちらのバナーから無料でダウンロードいただけます。

【実務用】ChatGPT利用ガイドラインに盛り込むべき必須7項目

ツールを導入するだけではリスクを抑えきれません。現場が守れる具体的なガイドラインが必要です。

入力禁止情報の定義(データ分類表の作成)

「機密情報を入れない」という曖昧な表現ではなく、データ分類に基づいた具体的な基準を提示します。

顧客個人情報や未公開の財務情報は「絶対禁止」、匿名化済みのデータは「条件付き許可」など、レベル別の可否を明示することで、従業員の判断迷いをなくします。

利用目的の限定と、AI出力をそのまま使わない運用の徹底

AIには「ハルシネーション(もっともらしい嘘)」のリスクがあるため、出力内容を鵜呑みにしてはいけません。

必ず人間がファクトチェックと脆弱性検査を行うことを義務付け、対外的な資料やプログラムにそのまま反映させないルールを徹底します。

生成された情報は必ず「人間の目」で確認してから使用することを徹底してください。

アカウント管理と認証ルール(SSO・MFAの必須化)

アカウントの乗っ取りを防ぐため、SSO(シングルサインオン)や多要素認証(MFA)の利用を必須とします。 退職者のアカウントを即座に無効化できる体制を整え、IDの使い回しを厳禁とします。

違反時の報告義務とペナルティの明文化

ルールを形骸化させないためには、意図しない入力が発生した際の「即時報告」を義務付けます。 隠蔽を防ぐために心理的安全性を担保しつつ、故意の重大な違反についてはペナルティの対象となることを明文化します。

シャドーAI対策ガイド|社員のAI利用に潜むリスクと今すぐできる対策

「社員がAIツールを使っているかもしれないが、実態が把握できていない」

——そんな不安を抱えていませんか?

IBMの調査によると、シャドーAI起因のデータ漏洩は通常より67万ドル(約1億円)コストが増大するという結果が出ています。

本資料では、シャドーAIの3大リスクと今すぐ始められる5つの対策ステップに加え、そのまま使えるAI利用ポリシー策定チェックリスト・入力禁止情報リストを収録しています。

以下から無料でダウンロードいただけます。

シャドーAIを抑止する組織的対策と承認フローの設計

技術やルールを補完するのが、組織的な運用フローです。

利用申請・承認フローの具体例

AI利用を希望する部署は、利用目的と扱うデータの種類を事前に申請します。

情シスが技術的安全性を、法務や部門長が機密性を判断するステップを設けることで、「誰がどの業務で使っているか」を可視化します。

職種・部門別の「AI利用研修」カリキュラムの設計

全社一律の研修に加え、営業部なら顧客情報の混入リスク、開発部ならコードの脆弱性リスクなど、職種に特化した教育が必要です。

自分事としての意識を高めることが、最大の防御に繋がります。

各部門の実際の業務に即した具体例を用いて、リスクを「自分事」化させることが重要です。

定期的なログ監査とコンプライアンスチェックの運用

ガイドラインは一度作って終わりではありません。

月次などで利用ログを確認し、不適切なプロンプトがないかをチェックします。 実態に合わせてガイドラインを定期的に見直すサイクルを確立しましょう。

【技術的対策】DLP・CASB・API活用による漏洩防止の強化

ヒューマンエラーを技術でカバーする「防御の層」を検討します。

CASB/SWGによる「個人アカウント利用」の強制ブロック

CASB(Cloud Access Security Broker)を導入することで、会社が認可していない個人用ChatGPTへのアクセスを遮断できます。 これにより、強制的に法人プランへ誘導し、シャドーAIを根絶します。

DLP(データ損失防止)ツールによる機密情報の自動検知

DLPツールを活用すれば、プロンプトに「マイナンバー」や特定のキーワードが含まれた際に、送信を自動でブロックすることが可能です。 従業員が意識せずとも、技術的に流出の芽を摘むことができます。

DLP(データ損失防止)機能を活用すれば、ヒューマンエラーによる漏洩を物理的に防げます。

API連携による「マスキング・匿名化」の自動実装

自社専用UIを構築する場合、APIにデータを投げる直前で、個人情報や機密情報を自動的に削除・置換する処理を組み込むことができます。 万が一、ユーザーが機密情報を入力しても、AI側には届かない仕組みを構築可能です。

シャドーAI対策ガイド|社員のAI利用に潜むリスクと今すぐできる対策

「社員がAIツールを使っているかもしれないが、実態が把握できていない」

——そんな不安を抱えていませんか?

IBMの調査によると、シャドーAI起因のデータ漏洩は通常より67万ドル(約1億円)コストが増大するという結果が出ています。

本資料では、シャドーAIの3大リスクと今すぐ始められる5つの対策ステップに加え、そのまま使えるAI利用ポリシー策定チェックリスト・入力禁止情報リストを収録しています。

以下から無料でダウンロードいただけます。

万が一、情報漏洩が疑われた時の「初動対応フロー」

インシデント発生時はスピードが命です。あらかじめ以下の手順を定義しておきます。

ステップ1:検知・報告とアカウントの即時凍結

漏洩を検知、または本人からの申告があった場合、被害拡大を防ぐために当該ユーザーのアカウントを直ちに凍結します。

ステップ2:影響範囲の特定とOpenAIへの削除申請

利用ログを調査し、「いつ、誰が、どのデータを入力したか」を特定します。 その後、OpenAIの公式サポートルートを通じて、入力データの削除申請を行います。

ステップ3:法的義務の確認

漏洩したデータが個人情報に該当する場合、「個人情報保護法」に基づき、本人への通知や個人情報保護委員会への報告が必要になるケースがあります。 法務部門と連携し、迅速に対外対応を判断します。

インシデント発生時は独断で動かず、定められた報告ラインに則って速やかに共有することが重要です。

シャドーAI対策ガイド|社員のAI利用に潜むリスクと今すぐできる対策

「社員がAIツールを使っているかもしれないが、実態が把握できていない」

——そんな不安を抱えていませんか?

IBMの調査によると、シャドーAI起因のデータ漏洩は通常より67万ドル(約1億円)コストが増大するという結果が出ています。

本資料では、シャドーAIの3大リスクと今すぐ始められる5つの対策ステップに加え、そのまま使えるAI利用ポリシー策定チェックリスト・入力禁止情報リストを収録しています。

以下から無料でダウンロードいただけます。

まとめ:リスクを正しく制御し、安全にAIの恩恵を享受するために

ChatGPT 情報漏洩のリスクは、ゼロにすることはできませんが、制御することは可能です。

対策のポイントは、データ学習を拒否する法人プランの採用、明確なガイドライン策定、そして技術的・組織的対策の併用の3点に集約されます。

ガイドラインは「禁止」のためのものではなく、従業員が「迷わず安全に使う」ための道標です。 まずは現状の利用実態を把握し、自社の機密レベルに合わせた最小限のルールから着手することをお勧めします。

シャドーAI対策ガイド|社員のAI利用に潜むリスクと今すぐできる対策

「社員がAIツールを使っているかもしれないが、実態が把握できていない」

——そんな不安を抱えていませんか?

IBMの調査によると、シャドーAI起因のデータ漏洩は通常より67万ドル(約1億円)コストが増大するという結果が出ています。

本資料では、シャドーAIの3大リスクと今すぐ始められる5つの対策ステップに加え、そのまま使えるAI利用ポリシー策定チェックリスト・入力禁止情報リストを収録しています。

以下から無料でダウンロードいただけます。

社内稟議に使える|ChatGPT法人プラン導入提案キット

社員が個人アカウントでChatGPTを使っている状況、放置していませんか?

法人プラン(Business/Enterprise)のプラン比較、ROI試算、セキュリティ要件、稟議書テンプレートまで、社内提案に必要な情報を1冊にまとめました。

こちらのバナーから無料でダウンロードいただけます。