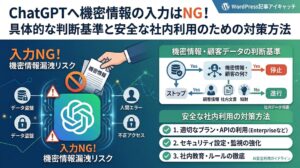

ChatGPTへ機密情報の入力はNG!具体的な判断基準と安全な社内利用のための対策方法

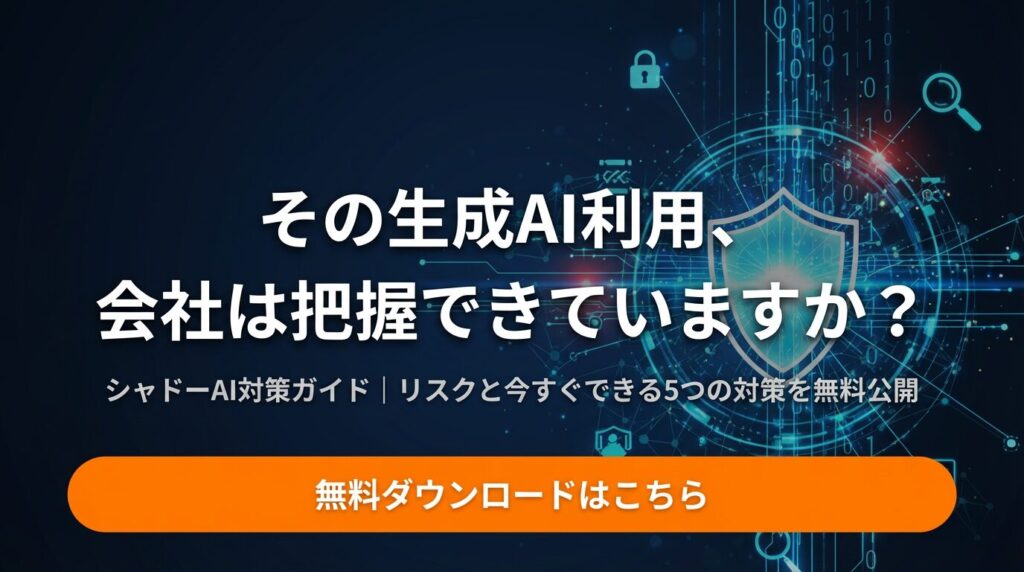

シャドーAI対策ガイド|社員のAI利用に潜むリスクと今すぐできる対策

「社員がAIツールを使っているかもしれないが、実態が把握できていない」

——そんな不安を抱えていませんか?

IBMの調査によると、シャドーAI起因のデータ漏洩は通常より67万ドル(約1億円)コストが増大するという結果が出ています。

本資料では、シャドーAIの3大リスクと今すぐ始められる5つの対策ステップに加え、そのまま使えるAI利用ポリシー策定チェックリスト・入力禁止情報リストを収録しています。

以下から無料でダウンロードいただけます。

ChatGPTに機密情報を入力してはいけない理由と漏洩リスク

企業がChatGPTを業務に導入する際、最も警戒すべきは「入力した機密情報の取り扱い」に関する問題です。

多くの利便性を持つ一方で、その裏側にあるリスクのメカニズムを正しく理解することが、組織を守るための第一歩となります。

個人アカウントを業務で無断利用する「シャドーAI」は、企業の管理外で情報漏洩を招く大きな要因となります。

入力データが「AIの再学習」に利用される仕組み

ChatGPTの無料版や個人向け有料プラン(Plus)では、デフォルトの設定で利用を続けると、ユーザーが入力したプロンプトやデータがAIモデルの精度向上のための「再学習」に利用される可能性があります。

これは、入力した機密情報がAIの知識の一部として取り込まれ、将来的に他のユーザーへの回答として意図せず出力されてしまうリスクを孕んでいます。

OpenAIのポリシーでは特定個人の露出は制限されていますが、技術的には「入力=外部への提供」に近い状態であることを忘れてはいけません。

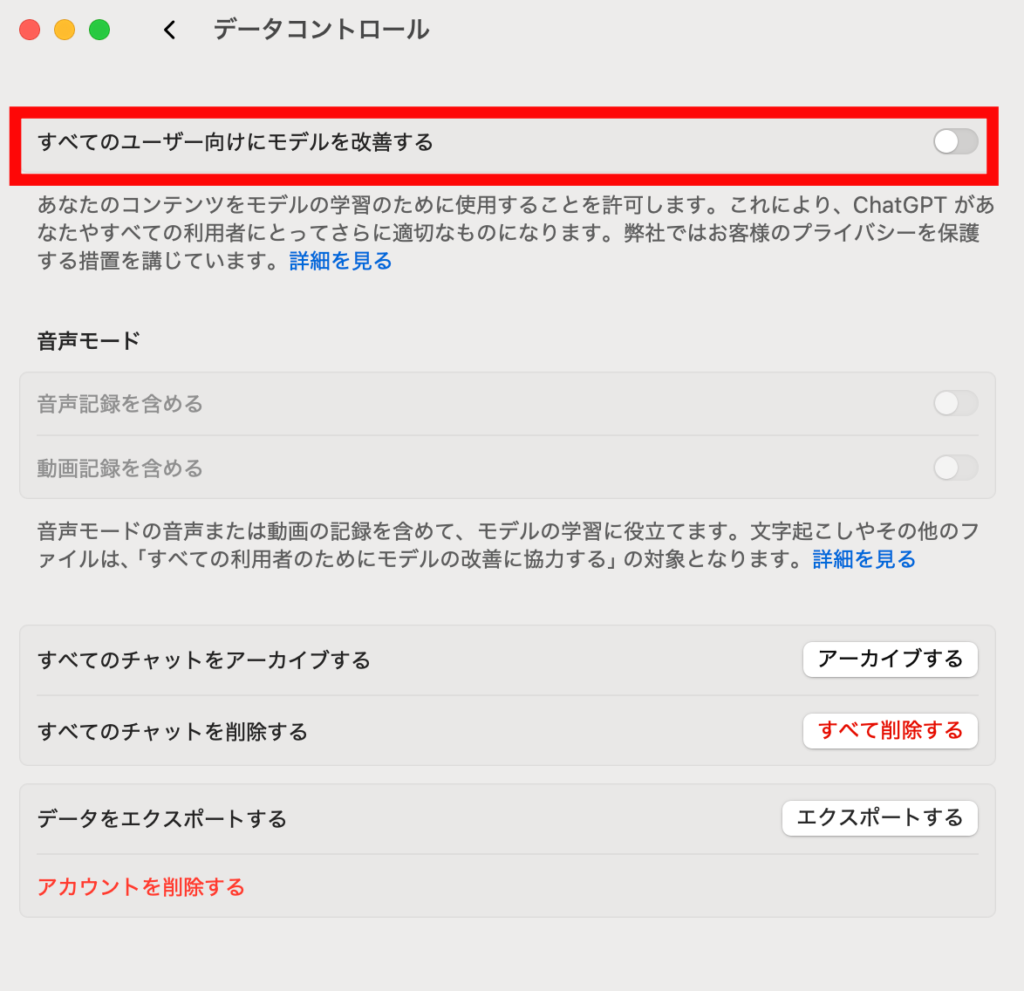

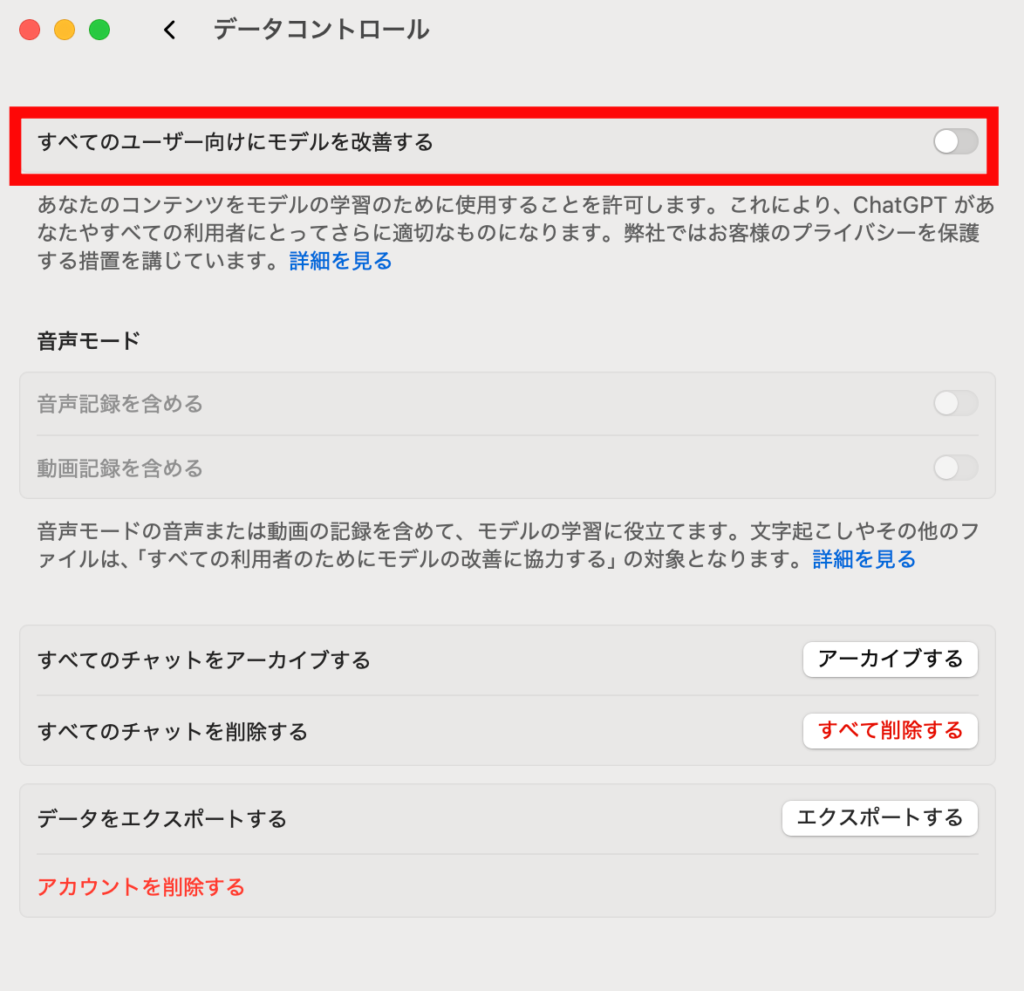

個人向けプランでは「すべてのユーザー向けにモデルを改善する」をオフにしない限り、入力データは再学習の対象となります。

【個人向けプランで学習利用を避ける方法】

1. 設定を開く

2. 「データコントロール」を選択

3. 「すべてのユーザー向けにモデルを改善する」をオフ

過去の流出事例から学ぶ:なぜソースコードや未公開情報が危ないのか

「ソースコードのバグ修正」や「未公開の会議録の要約」をChatGPTに依頼する行為は、セキュリティの観点から極めて高リスクとされています。

過去には、韓国のサムスン電子で同社エンジニアが社内ソースコードをChatGPTにアップロードし、誤ってリークさせた事案が発生しています。

(出典:Bloomberg)

ソースコードには自社独自のアルゴリズムや認証キーが含まれることがあり、これらがAIの学習データに含まれた場合、競合他社が類似のコードを生成しようとした際に自社のロジックが引用されるといった、深刻な知的財産権の侵害に繋がる恐れがあります。

「シャドーAI」の脅威:会社が把握していない個人アカウント利用のリスク

「シャドーAI」とは、システム部門が許可していないAIツールや、個人アカウントを業務で無断利用することを指します。

従業員が「使い慣れているから」と個人アカウントでChatGPTに機密情報を入力してしまうと、組織側で利用ログの監査ができず、万が一の際の追跡が困難になります。

当メディアの監修者である本城のXにて、シャドーAIについて詳しくまとめた記事を書いているのでシャドーAIの理解を深めたい方はぜひご覧ください。

日本の個人情報保護法・GDPRとの整合性と「外国への提供」に関する注意点

ChatGPTに個人情報を入力する場合、日本の個人情報保護法における「外国にある第三者への提供」に該当するリスクがあります。

OpenAIのサーバーは主に米国に所在しており、適切な同意取得や匿名加工が行われていない情報を入力することは、法規制に抵触する可能性があります。

企業は「個人情報の入力は原則禁止」とするか、適切なデータ処理義務(DPA)を締結した法人プランを利用するなどの対策が不可欠です。

シャドーAI対策ガイド|社員のAI利用に潜むリスクと今すぐできる対策

「社員がAIツールを使っているかもしれないが、実態が把握できていない」

——そんな不安を抱えていませんか?

IBMの調査によると、シャドーAI起因のデータ漏洩は通常より67万ドル(約1億円)コストが増大するという結果が出ています。

本資料では、シャドーAIの3大リスクと今すぐ始められる5つの対策ステップに加え、そのまま使えるAI利用ポリシー策定チェックリスト・入力禁止情報リストを収録しています。

以下から無料でダウンロードいただけます。

【プラン別】ChatGPTのデータ取り扱いとセキュリティ仕様の比較

ChatGPTには複数のプランが存在し、それぞれデータの安全性が大きく異なります。

自社のセキュリティポリシーに合わせた最適なプラン選択が、リスク管理の鍵を握ります。

法人向けのEnterpriseプランは、国際的なセキュリティ認証「SOC2」に準拠しており、高い信頼性を誇ります。

無料版・Plus版:履歴オフ(Chat history & training)設定とオプトアウトの効果

無料版およびPlus版は、標準では学習に利用される設定ですが、設定画面から「すべてのユーザー向けにモデルを改善する」をオフにすることで学習利用を停止できます。

ただし、履歴をオフにしてもデータは不正検知目的で一時的に保持されます。

また、管理者が一元管理できる仕組みではないため、組織的な対策としては不十分な側面があることに注意が必要です。

【個人向けプランで学習利用を避ける方法】

1. 設定を開く

2. 「データコントロール」を選択

3. 「すべてのユーザー向けにモデルを改善する」をオフ

社内稟議に使える|ChatGPT法人プラン導入提案キット

社員が個人アカウントでChatGPTを使っている状況、放置していませんか?

法人プラン(Business/Enterprise)のプラン比較、ROI試算、セキュリティ要件、稟議書テンプレートまで、社内提案に必要な情報を1冊にまとめました。

こちらのバナーから無料でダウンロードいただけます。

Team・Enterpriseプラン:標準で学習対象外となる法人向けセキュリティの強み

法人向けの「ChatGPT Team」や「ChatGPT Enterprise」では、入力データがモデルの学習に利用されないことが標準で保証されています。

さらにEnterpriseプランでは、SSO(シングルサインオン)や監査ログの取得、データの暗号化など、ビジネス利用に耐えうる強固なセキュリティ環境が提供されます。

組織のデータを安全に守りながらAIを活用したい場合に、最も推奨される選択肢です。

API利用:データの30日間保持ルールと学習に利用されない原則の確認

APIを通じてChatGPTを利用する場合、入力データは原則として学習に利用されません。

ただし、不正利用の監視目的で最大30日間データが保持されるというルールがあります。

30日を過ぎるとデータは自動的に削除されるため、長期的なデータ蓄積を防ぎたいシステム開発案件などにおいて有効な手段となります。

シャドーAI対策ガイド|社員のAI利用に潜むリスクと今すぐできる対策

「社員がAIツールを使っているかもしれないが、実態が把握できていない」

——そんな不安を抱えていませんか?

IBMの調査によると、シャドーAI起因のデータ漏洩は通常より67万ドル(約1億円)コストが増大するという結果が出ています。

本資料では、シャドーAIの3大リスクと今すぐ始められる5つの対策ステップに加え、そのまま使えるAI利用ポリシー策定チェックリスト・入力禁止情報リストを収録しています。

以下から無料でダウンロードいただけます。

実務で使える「ChatGPT入力禁止情報」の判断基準と具体例

ガイドラインを形骸化させないためには、従業員が「何を入力してはいけないのか」を具体的にイメージできる必要があります。

営業・広報部門:取引先名やプレスリリース前の情報を守るための代替表現案

顧客名やプロジェクト名などの固有名詞は、入力前に必ず伏せ字にするか、抽象的な表現に置き換えるルールを徹底してください。

例えば、「A社との新プロジェクト提案書」ではなく「製造業のクライアントに対する提案書」といった表現に変更します。

未公開のプレスリリースを要約させる場合も、社名や具体的な日付を伏せることでリスクを大幅に軽減できます。

開発・技術部門:ソースコードを安全にレビュー・要約させるための抽象化ルール

コードのデバッグに利用する際は、自社特有のロジックやIPアドレス、APIキー、接続先URLなどを必ず削除してから入力します。

OSSなどで公開されている一般的なアルゴリズムの解説に留めるなど、機密性の高い「自社アセット」を直接入力しないことが大原則です。

汎用的な関数部分のみを抜き出してレビューを依頼するなどの工夫が求められます。

人事・法務部門:個人情報・採用候補者データを取り扱う際の法的リスク管理

履歴書の内容、評価データ、社員の氏名などは「入力厳禁」の最優先事項として設定すべきです。

契約書のリーガルチェックに利用する場合も、当事者名や特約条項に含まれる固有情報をマスキングした上で、条文の一般的な解釈を確認する用途に限定するのが安全です。

【チェックリスト】入力前に確認すべき「4つの情報機密性ランク」

以下のランク表を参考に、従業員が自分自身で入力の可否を判断できる環境を整えましょう。

1. 極秘(入力厳禁): 未発表の知的財産、ログイン情報、個人情報

2. 社内秘(入力禁止): 組織図、社内マニュアル、特定の取引先名

3. 公開前情報(要マスキング): 近く公開予定のリリース、技術文書

4. 公開情報(入力可): 公式サイト公開済みの情報、一般的な知識

シャドーAI対策ガイド|社員のAI利用に潜むリスクと今すぐできる対策

「社員がAIツールを使っているかもしれないが、実態が把握できていない」

——そんな不安を抱えていませんか?

IBMの調査によると、シャドーAI起因のデータ漏洩は通常より67万ドル(約1億円)コストが増大するという結果が出ています。

本資料では、シャドーAIの3大リスクと今すぐ始められる5つの対策ステップに加え、そのまま使えるAI利用ポリシー策定チェックリスト・入力禁止情報リストを収録しています。

以下から無料でダウンロードいただけます。

企業の安全なAI利用を実現する「社内ガイドライン」策定の5ステップ

実効性のあるガイドラインを策定することで、従業員が迷わず安全にAIを活用できるようになります。

ガイドラインは策定して終わりではなく、定期的なリテラシー研修とセットで運用することが重要です。

ステップ1:利用目的の定義と許可されるツールの明文化

まずは「なぜAIを使うのか」を明確にし、許可された法人アカウント以外の利用を禁止することを明記します。

ステップ2:機密性レベルに応じた「入力許可・禁止事項」の策定

前述の判断基準をベースに、入力していい情報とダメな情報をリスト化し、現場の混乱を防ぎます。

ステップ3:利用申請フローと管理責任者の設置

誰がどのような目的で利用しているかを可視化するため、部門ごとの承認フローを構築します。

ステップ4:AI出力内容の正確性・著作権に関する免責事項の定義

ハルシネーション(もっともらしい嘘)のリスクを周知し、人間によるファクトチェックを必須とします。

ステップ5:定期的な利用ログ監視と従業員リテラシー研修の実施

管理コンソールから利用状況をモニタリングし、不適切な利用がないか定期的にチェックを行います。

シャドーAI対策ガイド|社員のAI利用に潜むリスクと今すぐできる対策

「社員がAIツールを使っているかもしれないが、実態が把握できていない」

——そんな不安を抱えていませんか?

IBMの調査によると、シャドーAI起因のデータ漏洩は通常より67万ドル(約1億円)コストが増大するという結果が出ています。

本資料では、シャドーAIの3大リスクと今すぐ始められる5つの対策ステップに加え、そのまま使えるAI利用ポリシー策定チェックリスト・入力禁止情報リストを収録しています。

以下から無料でダウンロードいただけます。

リスクをさらに抑える技術的対策とセキュリティツールの活用

組織的なルールだけでなく、システム的な「技術的対策」を組み合わせることで、防御力は飛躍的に高まります。

DLPツールを活用すれば、特定のキーワードを含むプロンプト送信を自動的にブロックできます。

AI利用に特化した「セキュアゲートウェイ」を導入すれば、すべてのプロンプトをログとして記録・保存でき、有害な回答や機密情報の流出をリアルタイムで検知することが可能です。

法人プランの導入コストを検討する際は、万が一の情報漏洩による損害賠償や、社会的信用の失墜といった甚大なコストと比較し、リスク回避の価値を評価することが重要です。

万が一、機密情報や個人情報を誤入力してしまった時の初動対応

インシデントは「起こり得るもの」として、あらかじめ事前の対応フローを定義しておく必要があります。

誤入力に気づいた場合は、直ちにセキュリティ担当者に報告し、「何を・いつ・どのアカウントで」入力したかを特定してください。

ChatGPTのUI上で会話履歴を削除するだけでなく、重要度に応じてOpenAIのプライバシーポータルからデータの削除依頼を申請します。

その後、原因を分析し、技術的制限の強化やプラン変更などの再発防止策を講じることが重要です。

シャドーAI対策ガイド|社員のAI利用に潜むリスクと今すぐできる対策

「社員がAIツールを使っているかもしれないが、実態が把握できていない」

——そんな不安を抱えていませんか?

IBMの調査によると、シャドーAI起因のデータ漏洩は通常より67万ドル(約1億円)コストが増大するという結果が出ています。

本資料では、シャドーAIの3大リスクと今すぐ始められる5つの対策ステップに加え、そのまま使えるAI利用ポリシー策定チェックリスト・入力禁止情報リストを収録しています。

以下から無料でダウンロードいただけます。

まとめ:ChatGPTの利便性を活かしつつ、組織として機密情報を守るために

ChatGPTは強力な武器になりますが、無防備な利用は大きなリスクを伴います。

再学習の仕組みやプラン別のセキュリティ仕様を正しく理解し、組織的な対策を講じることが不可欠です。

法人プランの導入、ガイドラインの策定、そして技術的ガードレールの設置という3点をパッケージで進めることで、安全なAI活用が可能になります。

定期的なアップデートを行いながら、組織全体で正しくAIを使いこなす文化を醸成していきましょう。

自社での対応に不安がある場合は、専門家への相談も有効な手段の一つです。

シャドーAI対策ガイド|社員のAI利用に潜むリスクと今すぐできる対策

「社員がAIツールを使っているかもしれないが、実態が把握できていない」

——そんな不安を抱えていませんか?

IBMの調査によると、シャドーAI起因のデータ漏洩は通常より67万ドル(約1億円)コストが増大するという結果が出ています。

本資料では、シャドーAIの3大リスクと今すぐ始められる5つの対策ステップに加え、そのまま使えるAI利用ポリシー策定チェックリスト・入力禁止情報リストを収録しています。

以下から無料でダウンロードいただけます。

社内稟議に使える|ChatGPT法人プラン導入提案キット

社員が個人アカウントでChatGPTを使っている状況、放置していませんか?

法人プラン(Business/Enterprise)のプラン比較、ROI試算、セキュリティ要件、稟議書テンプレートまで、社内提案に必要な情報を1冊にまとめました。

こちらのバナーから無料でダウンロードいただけます。